近年、企業の現場において従業員が独自の判断で生成AIツールを業務に利用するケースが増加しており、「シャドーIT」ならぬ「シャドーAI」の蔓延が新たなセキュリティ課題として浮上している。

エージェント構築プラットフォームの普及により誰もが容易にデジタルワーカを作成できるようになり、未検証のAIエージェントが従業員の許可(OAuth認可)を通じて組織のセキュリティ境界の外へデータを流出させてしまうリスクが高まっている。

こうした課題を受け、アイデンティティ管理サービスを展開するOkta, Inc.は2026年2月13日、組織内に潜むシャドーAIエージェントを検出し、そのリスクを可視化・軽減する新機能「Agent Discovery」を発表した。

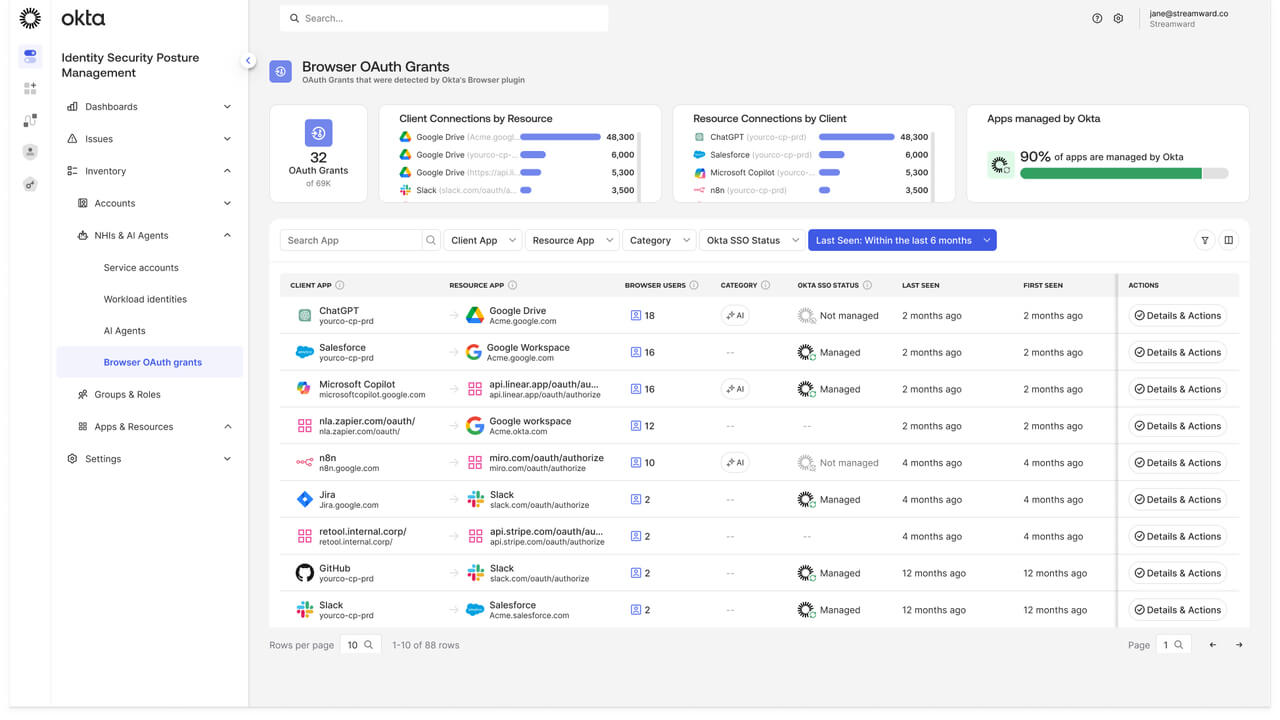

「Agent Discovery」は、非公認のプラットフォームや未検証のエージェントビルダ上で作成されたAIエージェントが、企業のリソースに接続しようとする動き(OAuthの同意)を発生源の時点で検知する機能だ。

Google Chromeなどのブラウザとの連携により、AIツール(クライアントアプリ)とデータソース(リソースアプリ)の関係性をリアルタイムでマッピングする。

非公認のツールを使用する未知のAIエージェントが重要なデータへのアクセス権限を取得した際には即座にアラートを発信し、セキュリティ審査を回避している未承認アプリを特定する仕組みとなっている。

発見されたAIエージェントは、Oktaのプラットフォーム上で「既知の管理されたアイデンティティ」として登録することが可能である。

これにより、セキュリティポリシーの適用や人間の責任者の割り当てを行うことができ、AIエージェントをガバナンスの統制下に置くことが可能だ。

なお、同機能は、同社の「Okta for AI Agents」ソリューションの一部として提供される。

OktaのAIセキュリティ担当SVPであるハリシュ・ペリ氏は、「AIエージェントはアプリケーション階層で動作し広範な権限を持つ非人間アイデンティティであると言及し、認可されたAIとシャドーAIの両方を大規模に保護するための可視性とガバナンスを本機能によって提供する」と述べている。

同社は今後、探索機能を管理されたAI/MLプラットフォームや大規模言語モデル(LLM)といった企業の重要資産の環境にも拡張していく計画だ。