AIの社会実装が進む中、EUでは2021年4月にAIの利用に関する規制案が発表されるなど、欧州や米国では、AIの説明責任や偏見に対する懸念が高まっている。

AIシステムは、判断過程がブラックボックス化しやすくその透明性を維持することが困難になる場合がある。責任あるAIシステムを構築するために、米グーグルや米マイクロソフトなどのIT(情報技術)企業を中心にAI倫理指針を公開する動きが広がっている。いかにしてAIの品質を担保し、信用を維持し続けることができるかが、これからの事業経営にとって重要な鍵となる。

AIは、常に再学習・更新をし続け、バイアスの排除を行いながら品質や精度を維持していくことが求められる一方で、運用段階で専門家がAIシステムを常時監視することは、コストやリソースの面でも大きな課題がある企業が多いのが現状である。

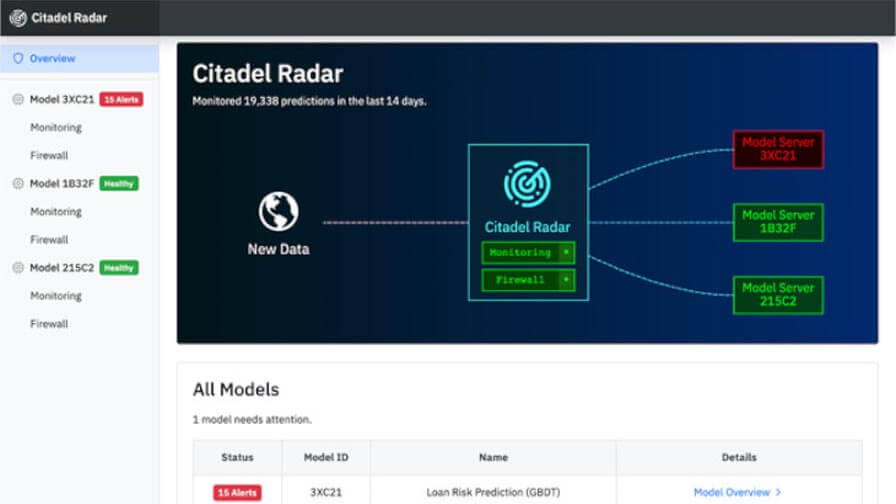

株式会社Citadel AIは、AIの品質保守を効率的に実現するツール「Citadel Radar」のβ版の利用募集を開始した。

Citadel Radarは、企業がもつAIシステムを自動モニタリングし、異常を検知・ブロック、可視化することで、AI固有のリスクから守る。AIを改修することなく、さまざまなAIのモデルやアプリケーションに適用可能だ。また、顧客のAIを自動モニタリングし、学習データと運用データの偏移、AIの予測値の経年変化、バージョン入れ替え等に伴う予測値の変動等をリアルタイムで検知することができる。

さらに、運用時の入出力データをさまざまな視点から自動で評価テストし、不正データ、異常値、悪意のある危険なデータなどをブロックしたり、レビュー用にタグ付けしてアラートを上げる。

そして、顧客のAIの思考過程を可視化し、推論結果に対する説明根拠を提示する。AIの学習時に生じたバイアスや推論時のモデルの脆弱性等を検知し、品質改善に役立てることができる。