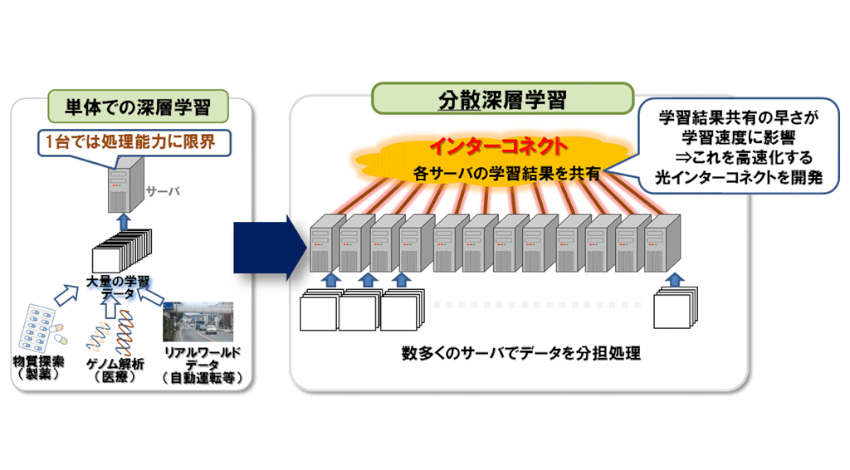

データ量の爆発的増大に伴い複雑化するデータ処理に対して、LSIの大規模化・高速化では処理能力向上の限界を迎える時代(以下、ポストムーア時代)が到来しつつある。ポストムーア時代に向け、演算リソースを複数接続し能力向上を図る分散処理が情報処理装置の性能向上の手法として期待されるが、そのためには演算リソース間のデータ共有が高速に行える高性能なインターコネクトが必要となる。

そこで、日本電信電話株式会社(以下、NTT)は光通信用に研究開発を続けてきた高速プロトコル技術・通信処理回路技術を活用し、情報処理システムの性能向上を実現する光インターコネクトを開発した。この光インターコネクトは、アプリケーションとしてAIに注目し、自動運転やゲノム解析などといった、リアルワールドの大量なデータを高速に処理するために数多くのサーバで分散処理を行う「分散深層学習」に適しており、AI学習の高速化を実現した。

現在用いられている市販品で最速の構成(※1)と同技術を用いた場合の比較測定を行った結果、4台のサーバ(1台当たり1GPU ※2)を利用した場合、通信のために生じる演算待ち時間(通信オーバーヘッド)が84%以上削減されることが確認され、この結果、学習速度が7%向上することを確認した※3。この測定結果をもとに、GPU台数を増やした場合の見積もりを行うと、32GPU利用時に40%以上学習速度が向上する見積もりが得られた※4。

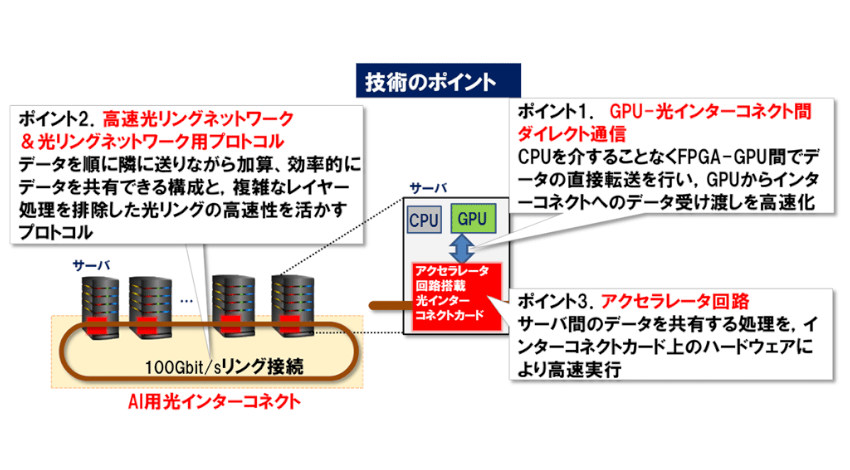

同成果の光インターコネクトは、分散深層学習のデータ共有の高速化を、以下の3点の技術的ポイントで実現している。

- CPUやメインメモリを介することなく、学習処理を行うGPUと光インターコネクト間で直接データを授受できるようにし、演算リソース(GPU)と光インターコネクトをより密接に結び付けるGPU-光インターコネクト間ダイレクト通信

- データを順に隣に送りながら加算することで効率的にデータ共有が行える100Gbit/sの高速光リングネットワークと、複雑なレイヤー処理を排除した光リングの高速性を活かすプロトコル

- データ共有処理を専用のハードウェアで高速に実行するアクセラレータ回路

大規模なAI学習を行うデータセンタに今回の技術を導入することで、今後の自動運転・遺伝解析・気象予測など、大量のデータを扱うAI学習処理の高性能・低消費電力化が期待される。そのため、NTTのAI「corevo」を支える基盤技術の1つとして開発を続ける。また、ポストムーア時代のIOWN※5構想の実現に向けた、光と電子の利点を結び付けた新アーキテクチャによる情報処理システムを実現する技術として、今回開発された技術を応用・発展させるとした。

※1 100Gbit/s InfiniBand + 市販最新GPUの組み合わせ

※2 Graphics Processing Unitの略。3Dグラフィックスの演算に特化したLSI。AIに必要な演算にも高い性能を発揮するため、近年ではAIの演算用に積極的に用いられる。

※3 データセット:Imagenet、学習モデル:ResNet50、サーバ4台、1GPU/サーバでの実測

※4 サーバ4台、8GPU/サーバでの見積もり

※5 Innovative Optical & Wireless Network

無料メルマガ会員に登録しませんか?

IoTに関する様々な情報を取材し、皆様にお届けいたします。