機械学習の力で自ら学び、自律稼働できるスマートな新世代のマシンを作ることができるNVIDIA Jetson TX1 の提供を日本でも開始するにあたり、NVIDIA プロダクトマネージャー ジェシー・クレイトン氏からプレス向けの発表があった。

Jetson TX1は、組込みビジュアルコンピューティング向けのプラットフォームだ。Jetson TX1 開発キットが2016年3月中旬(アメリカでは599ドル)、Jetson TX1 モジュールが2016年上半期(アメリカでは1,000個購入で1台当たり299ドル)に発売される。

1年ほど前に登場したJetson TK1のデベロッパーキットは、コンピュータービジョン、グラフィックス、GPUなどを使った作業を10ワット以下でベストのパフォーマンスを実現するためのもので、例えばパーソナルロボット「Jibo」や、ディープラーニングが使われているインテリジェントオーブン「June」などに使用されている。

「将来のドローン、ロボットなどに共通しているのは、自律性を持っていることだが、全ての機器に対して『モノを見る機能』が必要だ。モノを見ることによって対象物をトラッキングしたり、場所を特定したり、自ら操縦したり、識別したりということを、正確に実現する装置が必要になる。」(ジェシー・クレイトン氏)

しかし自律機器に対してクラウドを使うと、遅延が発生してしまうので現実的ではないという。そこで、どうしたらいいかと考えたとき、一番早いプロセッサを使えばいいのではないかと考え、Intel Core i7を検討したが、消費電力が65ワットもあることが課題となった。たとえば、この65ワットのプロセッサをドローンに載せようとするとそれに見合った冷却のシステムが必要になるため重量が増える。さらに、それを支えるためのモーターのサイズ、駆動を長持ちさせるバッテリーのサイズが大きくなる。ということを考えると、デスクトップのプロセッサをドローンに使うのは現実的ではないという結論になったというのだ。

次に考え付くのは、GPU(Graphics Processing Unit)を使うことだ。これまでディープラーニングにGPUは使われているが、現在のところパフォーマンスと消費電力とサイズ、全部がバランスよく存在するようなGPUがなかった。そこで今回のJetson TX1を開発したという。

Jetson TX1はモジュール型のスーパーコンピュータで、クレジットカードより小さい。スペックは下記のとおり。

Jetson TX1は自律機器のために設計されているため、ロボットやドローンなどに使うことができるということだ。

特徴としてはディープラーニングの「推論」という作業をするにあたり、Jetson TX1のエネルギー効率はIntel Core i7 6700Kよりも10倍高く、エネルギー効率だけではなく、ピークパフォーマンスにおいてもJetson TX1の方が非常に高いパフォーマンスだという。

ジェシー・クレイトン氏によると、ディープラーニングが以前より高度になってきている理由は3つあるという。

1つめはビッグデータの存在で、現在安価なセンサーが色々なモノについており、そこからたくさんのデータがあがってきてクラウドの中に存在し、様々な学習ができる状態になっていること。

2つめは新しいアルゴリズムが開発され、それによってトレーニングにかかる時間が短縮されたこと。

3つめにGPUの存在で、以前は数か月、数年かかったトレーニングが、最近では数日、数週間で完了するようになったことだという。

画像を判断するイメージネットチャレンジにおいて、2010年は正答率が72%つまり28%が解答を間違え、1年後改善されたのは2%だけだった。その後2012年にディープラーニングが登場したところ、下記グラフのように正解率がどんどんあがり2015年にはついに人間を超えた。

つまりコンピュータの方が、人間よりもよく画像を認識する世界になったことを意味する。

Jetson TX1 搭載のドローン

農業やインフラ点検などの産業用ドローンを作っている株式会社エンルート イエン・カイ氏からも発表があった。同社は現在、自動運転車の技術をドローンに入れようとしている。

例えばJetson TX1 搭載のドローンでパトロールをしていて不審者を見つけた時、全ての映像をサーバーに送るのはネットワークがもたないため、不審者のクルマのナンバープレートだけを切り出してその部分だけをクラウドに送ることができるという。

ディープラーニングを用いたナビゲーションのサンプルとして、カメラから映像を取り入れて、飛びながら映像に映し出された種類を判別しているものの紹介があった。

コンクリートは赤、クルマなどの金属類は紫などピクセルごとに色分けがしてあり、このシステムの中核はケンブリッジ大学が自動運転車向けに開発したSegNetというもの。エンルート社が開発しているのは、SegNetからの結果をリアルタイムに読み込んで建物を判別したらよけるなどを制御しているシステムで、最終的にそれをモーター信号に変換して機体を制御するのは、フライトコントローラー(APM)の部分だ。

エンルート社がユーザーとして考えるJetson TX1のアドバンテージは、10ワットという組込みの枠の中でトップのパフォーマンスを出していること、開発者にとってのメリットとして、エコシステムがあるおかげでデスクトップで学習したものをシームレスに組み込みの方へ持っていくことができること、などをあげた。実際にJetson TX1が届いてシステムを動かすまでに2時間かからなかったという。

デモンストレーション

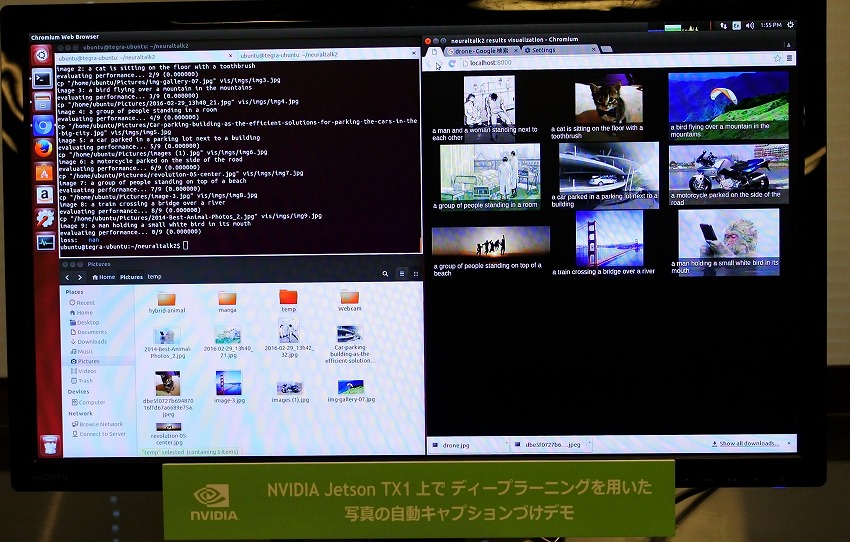

上記はディープラーニングを用いた写真の自動キャプションづけデモだ。

「写真に『路肩に駐車しているバイク』、『人のグループがビーチいる』、『建物の横に駐車されているクルマ』などのキャプションが自動でつけられている。まだ完璧ではないものもあり、『歯ブラシを加えたネコが床に座っている』というキャプションは、本当は『首に蝶ネクタイをつけたネコ』なのだが、なんとなくわかる間違いをしていることがわかる。」(ブース担当者)

また、上記は、ディープビジュアライゼーションのデモだ。

「人間が画像を認識するときのニューロンの働き、視神経の構造などにもインスパイアされたニューラルネットワークだという。これまでは中はどうなっているのか?というのがわかりづらく、ブラックボックスとして扱われていたが、この分野でもリサーチが進んでおりビジュアライズが可能になった。」(ブース担当者)

例えば救急車を認識する際に、最初のころは赤に反応するというような画像フィルターをかけ、5層目にいくと例えば白背景に赤のストライプというものに反応するニューロンがある。さらに人間が意識しないような、救急車の下にある道路まで認識している様子がわかる(上記写真)。

写真では見えにくいが、駐車場に停められているクルマが点群で表示されているデモだ。

「Structure from Motion(SfM)と言われるアルゴリズムを使って、点群を記述してそれだけを見るということができる。これを元にバーチャルフェンスを表示すると、これを利用して駐車場の形状を把握して自動駐車への利用も想像できる」(ブース担当者)

【関連リンク】

・NVIDIA

無料メルマガ会員に登録しませんか?

IoTに関する様々な情報を取材し、皆様にお届けいたします。