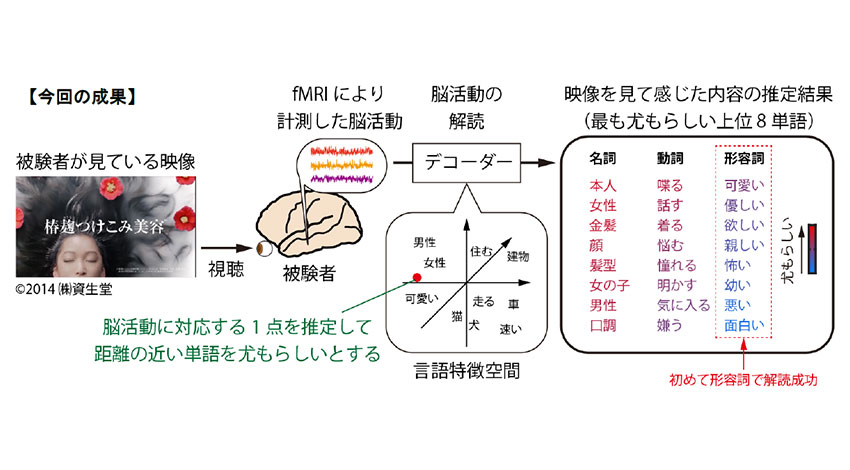

国立研究開発法人情報通信研究機構(NICT)の脳情報通信融合研究センター(CiNet)のグループは、映像を見て感じた「物体・動作・印象」の内容を、脳活動を読み解くことで、1万語の「名詞・動詞・形容詞」の形で言語化する脳情報デコーディング技術を開発した。

従来の脳情報デコーディング技術では約500単語に対応する物体や動作の内容を解読していたのに比べ、同技術の開発により、おおよそ20倍の1万単語に対応する内容を脳から解読することが可能となった。さらには従来技術では解読できなかった“印象”の内容についても、形容詞の形で解読に成功した。

同技術を基盤技術とすることで、映像を見て感じたことを脳活動から読み取り評価する脳情報デコーディング技術に基づく映像コンテンツ評価手法や、発話や筆談が困難な方々などが頭の中で考えただけで内容を言語化してコミュニケーションを行う手段などの社会実装が期待される。

映像コンテンツ評価手法については、2016年度から開始したCMなどの映像コンテンツ評価サービス事業に同技術が利用されている。

なお、この成果は神経科学の国際科学誌「NeuroImage」オンライン版に掲載された。

背景

画像や映像を見て感じたことを脳活動から読み取る脳情報デコーディング技術は、脳と機械のインタフェースなどの未来の情報通信技術の基盤技術として重要な役割を担う技術だ。

近年、その一つの実装の形として、感じたことを単語の形で言語化して脳活動から読み取る技術が開発されている。これまでには、映像を見て感じた物体と動作の内容を、約500語の単語の形で推定した例がある。

しかし、500単語でも実世界においては少なく、脳情報デコーディング技術を社会で実用化するためには、もっと多様な内容をもっと多くの単語に対応する形で脳活動から読み取ることが必要となっている。

開発の内容

同研究において、CiNetの西田知史研究員と西本伸志主任研究員は、映像を見て感じる様々な「物体・動作・印象」の内容を、それらに対応する1万語の「名詞・動詞・形容詞」の形で推定する脳情報デコーディング技術を開発した。

この技術の特徴は、大規模テキストデータから学習した言語特徴空間を、脳活動の解読装置であるデコーダーに取り入れて、映像を見て感じた内容の推定に利用した点だ。

ここでの言語特徴空間とは、単語同士の意味的な近さ・遠さを空間内の位置関係により表現する100次元空間のことだ。この空間内では、大規模テキストデータに含まれている1万語の「名詞・動詞・形容詞」がそれぞれ空間内の1点として表現されており、意味の近い単語(例: 猫と犬)は近い距離で表現され、意味の遠い単語(例: 猫と建物)は遠い距離で表現される。

この1万語の表現を持つ言語特徴空間を取り入れることによって、従来技術の約20倍となる1万単語を用いて、脳活動から映像を見て感じたことの解読が可能となった。

さらに、従来技術では名詞・動詞に対応する物体・動作の内容のみを解読していたが、言語特徴空間に含まれる形容詞を用いて、対応する“印象”内容も感じた内容として解読することに成功した。

同技術は、CMなどの自然な映像を視聴中の被験者から機能的磁気共鳴画像法(fMRI)により計測した脳活動を、解読の対象とする。

脳活動の解読を行うデコーダーは、脳活動と言語特徴空間の対応関係を保持しており、新しい脳活動が入力されると、対応関係を利用して言語特徴空間内の1点を推定する。そして、脳活動から推定した点からの距離の近さに基づいて、1万単語それぞれのもっともらしさを出力する。

もっともらしい単語ほど、その被験者が映像を見て感じた内容に近いとみなされることになる。

なお、同技術はNICTから株式会社NTTデータにライセンス提供され、「脳情報デコーディング技術に基づいたCMなどの映像コンテンツ評価サービス(NeM sweets DONUTs)」として、2016年度から株式会社NTTデータにより事業展開されている。

【関連リンク】

・情報通信研究機構(NICT)

無料メルマガ会員に登録しませんか?

技術・科学系ライター。修士(応用化学)。石油メーカー勤務を経て、2017年よりライターとして活動。科学雑誌などにも寄稿している。